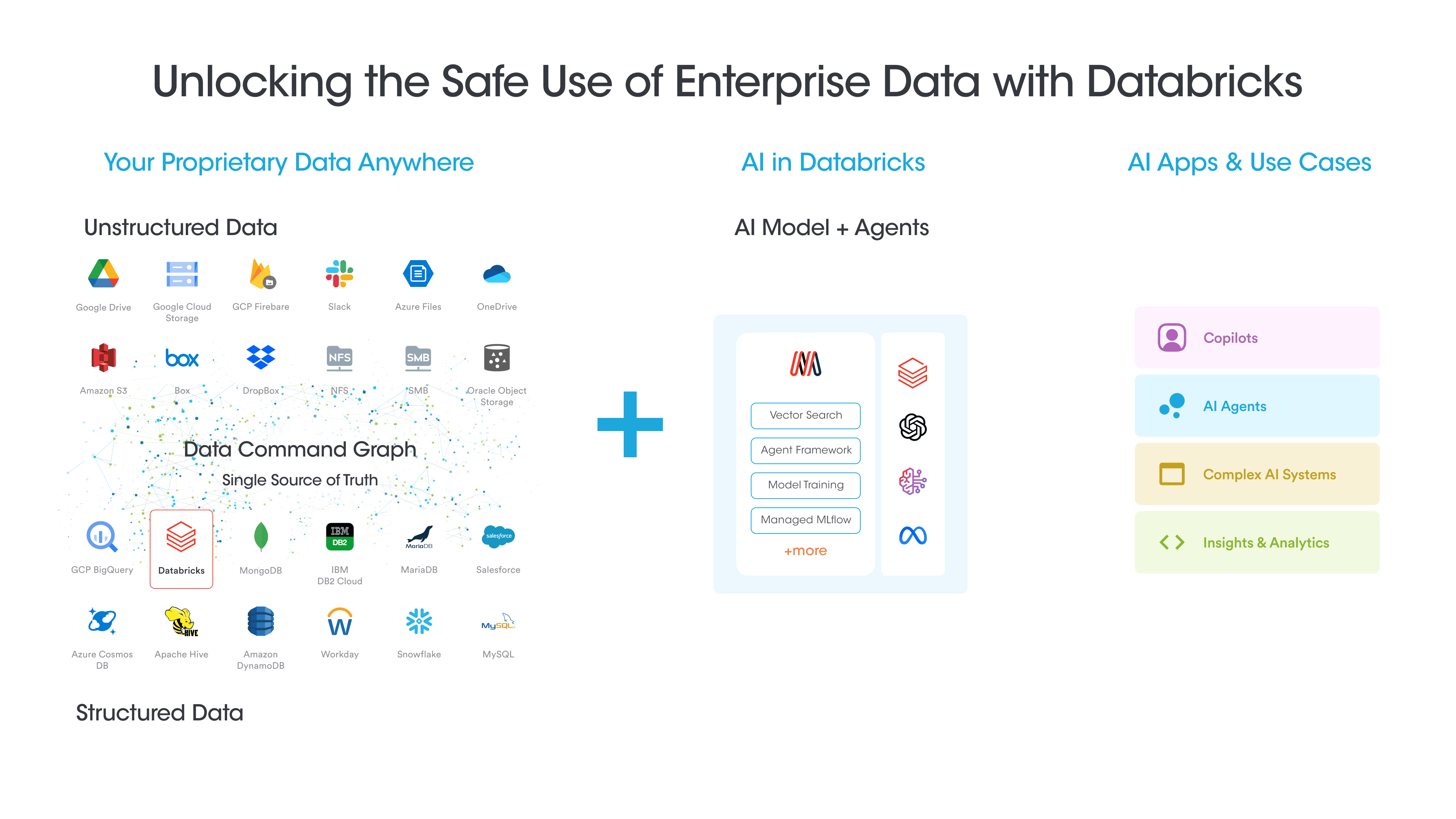

الشكل 5. Data Command Graph يوفر رؤية عميقة مدمجة وتتبعًا دقيقًا لأصول أنظمة الذكاء الاصطناعي

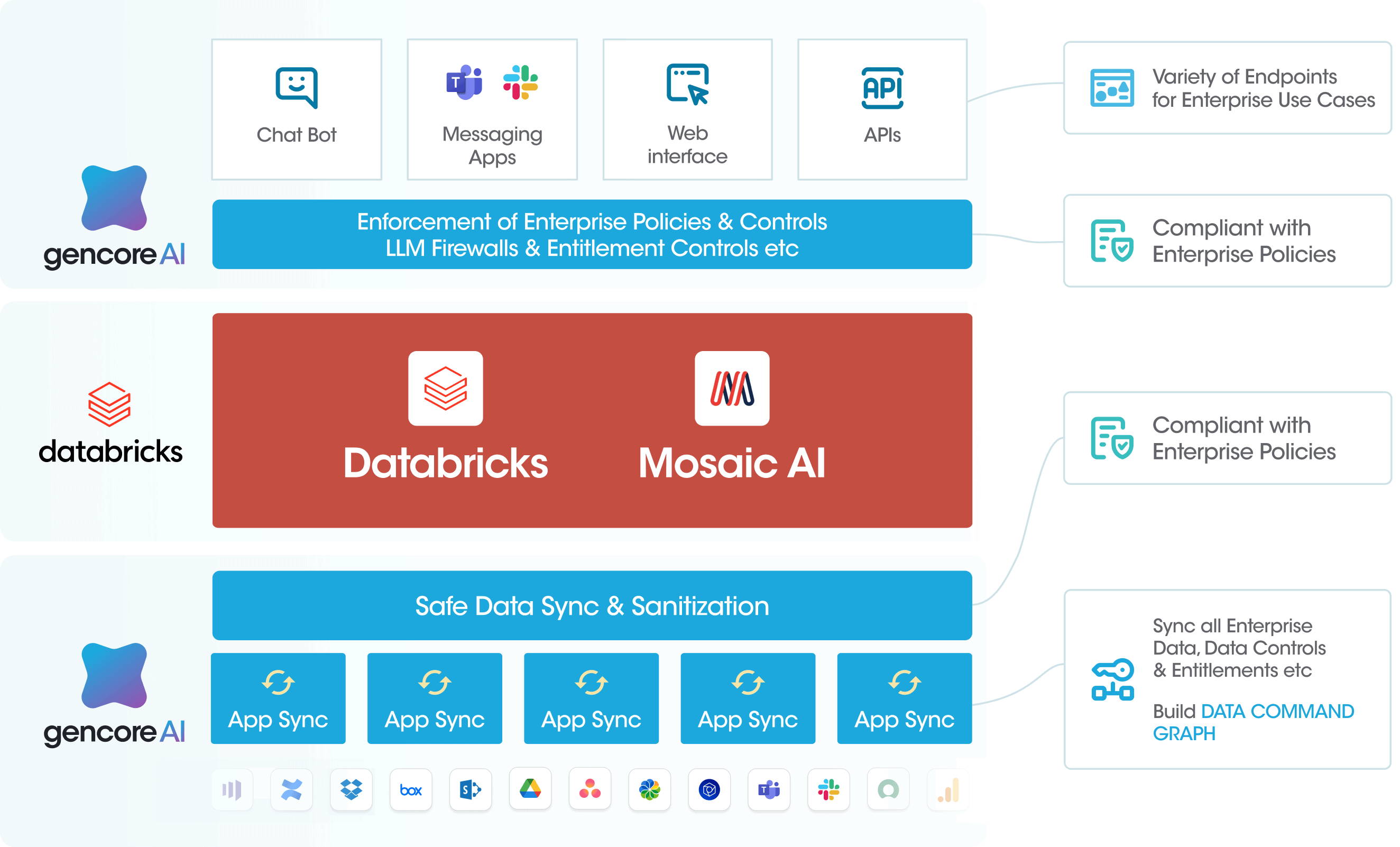

حالات الاستخدام النموذجية مع Gencore AI والذكاء الاصطناعي في Databricks

يُمكّن دعم تقنية Mosaic AI وجداول Delta من Databricks في Gencore AI المؤسسات من بناء أنظمة ذكاء اصطناعي آمنة وعالية الجودة، تُوازن بين الابتكار والأمان والامتثال. تشمل حالات الاستخدام الرئيسية ما يلي:

1. استيعاب البيانات بشكل آمن من مصادر متنوعة لذكاء الذكاء الاصطناعي في داتابريكس

يتيح هذا الحل استيعاب البيانات بشكل شامل في جداول دلتا Databricks من خلال مسارات بيانات آمنة.

- الاتصال بسلاسة بقواعد البيانات المحلية، ومنصات التخزين السحابي، وتطبيقات SaaS (Salesforce، وServiceNow، وWorkday، وما إلى ذلك)، وأنظمة البيانات المحلية، مما يتيح إدارة مركزية للبيانات في جداول دلتا.

- تَأثِير Securiti 's Data Command Graph لاختيار مجموعات البيانات ذات الصلة تلقائيًا بناءً على سياق العمل والبيانات الوصفية ومتطلبات الامتثال.

- ضمان حداثة البيانات وتفردها وملاءمتها للموضوع للحصول على مدخلات عالية الجودة لتدريب نماذج الذكاء الاصطناعي وضبطها.

- تنظيف البيانات غير المهيكلة والبيانات المهيكلة تلقائيًا ، بما في ذلك التنقيح والإخفاء وإخفاء الهوية بناءً على مستويات حساسية البيانات والسياسات التنظيمية.

- مراقبة تدفقات البيانات للتأكد من الالتزام بلوائح الخصوصية وسياسات الأمان ومتطلبات سيادة البيانات.

تُرسّخ هذه القدرات أساسًا قويًا لعمليات البيانات الآمنة والمتوافقة التي تدعم تدريب وضبط نموذج الذكاء الاصطناعي داخل نظام Mosaic AI البيئي.

2. توفير ضوابط بيانات أساسية لدعم الاستخدام الموسع للبيانات والذكاء الاصطناعي

يُمكّن هذا الحل من اعتماد الذكاء الاصطناعي بشكل آمن وعلى نطاق واسع من خلال تطبيق ضوابط حوكمة شاملة وضمانات عبر أنظمة الذكاء الاصطناعي والبيانات، مما يساعد المؤسسات على توسيع قدراتها في مجال الذكاء الاصطناعي بثقة مع الحفاظ على الإشراف.

- تمكين التوافق مع معايير OWASP Top 10 لأنظمة إدارة التعلم من أجل أنظمة ذكاء اصطناعي آمنة. توفير عرض كامل لمصدر بيانات الذكاء الاصطناعي والبيانات قائم على الرسوم البيانية، وفقًا لمتطلبات لوائح الذكاء الاصطناعي المختلفة.

- فرض تنظيف البيانات في الوقت الفعلي عبر مسارات الذكاء الاصطناعي في Databricks، والكشف التلقائي عن المعلومات الحساسة وحمايتها من خلال الإخفاء وإخفاء الهوية بناءً على سياسات تصنيف البيانات.

- توفير معلومات حول استحقاقات المستخدمين واللوائح التنظيمية المتعلقة بالبيانات التي تم إدخالها في Databricks، بالإضافة إلى رسوم بيانية للوصول والاستحقاقات للبيانات في Databricks.

- توفير جدران حماية LLM لضمان الأمن والامتثال لضوابط الشركات بشأن استخدام الذكاء الاصطناعي، ومنع هجمات الحقن الفوري، والحماية من تسرب البيانات، ومراقبة المدخلات المعادية.

تُمكّن هذه الضوابط المؤسسات من توسيع نطاق مبادرات الذكاء الاصطناعي المؤسسية مع الحفاظ على متطلبات الأمن والامتثال والحوكمة.

3. بناء تطبيقات ذكاء اصطناعي شخصية تراعي الأذونات

توفر Gencore AI إطار عمل شاملاً لتطوير تطبيقات ذكاء اصطناعي شخصية تراعي الصلاحيات على منصة Databricks. يتيح هذا الحل ما يلي:

- تطوير تطبيقات الذكاء الاصطناعي الواعية بالسياق والتي تتكيف تلقائيًا مع أذونات واستحقاقات كل مستخدم، مما يضمن وصول الموظفين واستخدامهم فقط لميزات الذكاء الاصطناعي المناسبة لدورهم ومستوى تصريحهم.

- التكامل السلس لحوكمة بيانات المؤسسة مع سير عمل الذكاء الاصطناعي من خلال عناصر التحكم الآلية في الوصول، والتحقق من الأذونات في الوقت الفعلي، وتسجيل التدقيق الدقيق - مما يخلق أساسًا لتطوير الذكاء الاصطناعي المسؤول.

- إنشاء تجارب ذكاء اصطناعي مخصصة من خلال الاستفادة من بيانات المستخدم الوصفية الغنية وأنماط التفاعل وبيانات الاستخدام التاريخية مع الحفاظ على حدود أمنية صارمة ومتطلبات الامتثال.

يتيح هذا النهج على مستوى المؤسسات للمؤسسات بناء تطبيقات ذكاء اصطناعي متطورة ومدركة لاحتياجات المستخدم على منصة Databricks مع الحفاظ على ضوابط الأمان والامتثال التنظيمي على نطاق واسع.

في Securiti ، مهمتنا هي تمكين المؤسسات من تسخير القوة الهائلة للبيانات والذكاء الاصطناعي بأمان. يدعم Gencore AI منصتي Mosaic AI وDelta Tables من Databricks، مما يتيح للمؤسسات استخدام بياناتها الخاصة لتطوير ونشر نماذج الذكاء الاصطناعي، بدءًا من تدريب النماذج وضبطها وصولًا إلى إنشاء نماذج خطية لغوية مخصصة واستنتاج البيانات في بيئة الإنتاج. يساعد هذا التكامل المؤسسات على الانتقال بسرعة وأمان من مرحلة إثبات المفهوم إلى أنظمة الذكاء الاصطناعي المؤسسية.

هل ترغب في مشاهدة عرض توضيحي؟ أرسل طلبًا لعرض توضيحي على Gencore.AI .