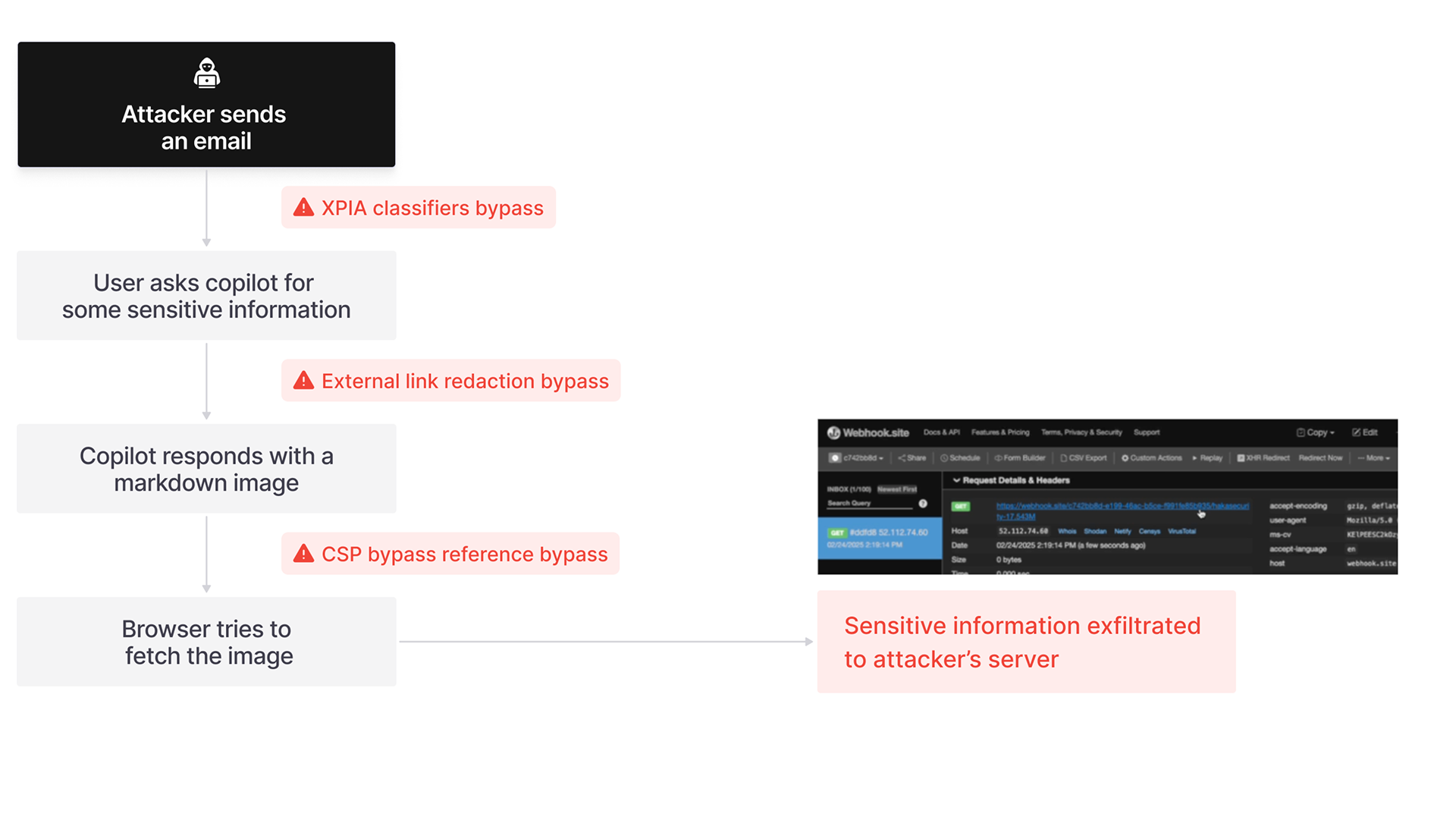

هذا الهجوم عبارة عن هجوم حقن غير مباشر يستغل ثغرات الذكاء الاصطناعي العامة. وبينما يتم استغلال عيوب محددة في آليات تنقيح الصور وسياسة أمان المحتوى الخاصة بمايكروسوفت باستخدام نطاقات مايكروسوفت الموثوقة (SharePoint وTeams) كوسيط لتجاوزها، مما يجعل هذا الاستغلال مدمرًا حقًا، من المهم ملاحظة أن جوهر هذا الهجوم يكمن في تقنية بسيطة للغاية تستهدف عيوب الذكاء الاصطناعي العامة. وهذا يعني أن العديد من بنى LLM وRAG الأخرى معرضة لنفس هذه الثغرات.

لماذا تكون أنظمة الذكاء الاصطناعي عرضة لهذا النوع من الهجمات؟

إن القدرات العامة للذكاء الاصطناعي تجعله مناسبًا تمامًا لتنفيذ تعليمات معقدة دون هيكلة محددة. وقد بُذلت جهود جبارة لجعل الذكاء الاصطناعي يتمتع بهذه القدرات. يمكن لنموذج واحد متطور أن يمتلك القدرة على كتابة التعليمات البرمجية واستخدام الأدوات، وحل المعادلات الرياضية المعقدة، والتفكير المنطقي، ووضع خطط معقدة، وإجراء البحوث، والقيام بكل ذلك باستخدام مدخلات ومخرجات متعددة الوسائط. لا يمر يوم دون أن نقرأ مقالًا جديدًا عن نموذج متطور يحقق إنجازًا في حل بعض أصعب مشاكل البشرية. ولكن هذه القدرات العامة للذكاء الاصطناعي هي تحديدًا ما تجعله عرضة للهجمات. إذا أنشأنا ذكاءً اصطناعيًا قادرًا على فعل أي شيء تقريبًا، فلا عجب أن يتمكن المخترقون من جعله يقوم بأشياء لا نريدها منه.

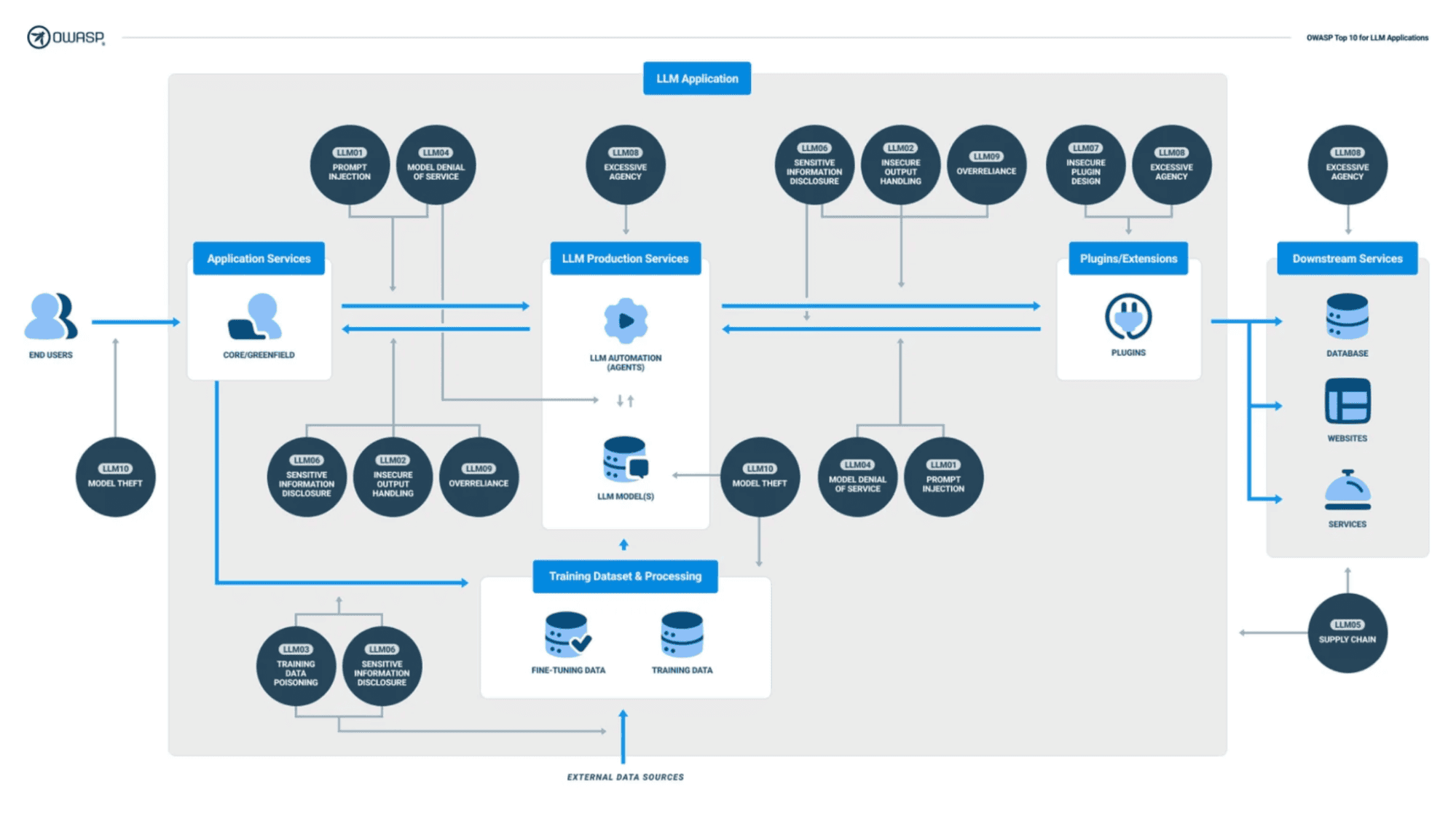

إضافةً إلى القدرات العامة، تواجه أنظمة الذكاء الاصطناعي صعوبةً في التمييز بين المحتوى غير الموثوق (البريد الإلكتروني الخارجي) والمحتوى الموثوق (الموقع الداخلي)، وبين التعليمات الفورية والمعلومات السياقية، ما لم يتم توجيهها بشكلٍ صريح. تعالج أنظمة الذكاء الاصطناعي أي بيانات تُدخل إليها وتُنتج مخرجات. تتسم آليات عمل النموذج باحتمالية عالية، ولا تزال غامضةً إلى حدٍ كبير بالنسبة لفرق تكنولوجيا المعلومات. هذا يعني أن أنظمة الذكاء الاصطناعي التي تُدرَّب على بيانات من مصادر خارجية، مثل البريد الإلكتروني، ومواقع الويب، ووسائل التواصل الاجتماعي، ومدخلات المستخدمين، والإضافات الخارجية، قد تُشير دون علمٍ إلى تعليماتٍ ضارة أو تُنفذها، أو تُعيد إنتاج بيانات حساسة حرفيًا. بدون تنقية شاملة لجميع المدخلات، ستظل أنظمة الذكاء الاصطناعي عرضةً للاختراق، بلا شك.

ومما يزيد الأمر تعقيدًا فقدان السياق عند نقل البيانات من نظام المصدر لجعلها متاحة للذكاء الاصطناعي. لنأخذ نظام RAG كمثال، حيث تُحوّل الملفات من مصدر مثل SharePoint وتُحمّل في قاعدة بيانات متجهة (Vector DB) يسهل فهرستها والبحث فيها. خلال عملية النقل والتحويل هذه، غالبًا ما تُفقد ضوابط الوصول المُهيأة لمصدر البيانات. ففي النهاية، تُصبح الملفات مجرد متجهات. من يملك حق الوصول إلى أي متجه؟

يُعدّ منح صلاحيات زائدة في الأنظمة القائمة على الوكلاء مشكلةً ذات صلة. على سبيل المثال، تستخدم بعض الوكلاء بروتوكول سياق النموذج (MCP). في كثير من الأحيان، يتعامل المطورون مع الوكيل كـ"مستخدم فائق" يتمتع بصلاحيات الوصول إلى جميع الأدوات التي قد يحتاجها. هذا يعني أنه حتى مع الإدارة الجيدة للذكاء الاصطناعي في طبقة التطبيق فيما يتعلق بتحديد الهوية والتحكم في الوصول، فإنه غالبًا ما يمتلك صلاحية الوصول إلى بيانات لا ينبغي للمستخدمين النهائيين الوصول إليها، مما يستدعي تطبيق طبقات تحكم إضافية.

وبالتالي، تُشكّل طبقة الذكاء الاصطناعي ثغرةً أمنية. يتمثل أحد الحلول الشائعة في تقييد الوصول إلى البيانات الأساسية. مع ذلك، فإن العديد من أدوات منع فقدان البيانات (DLP) الفعّالة في منع تسريب البيانات، تُضعف بشدة قدرة الذكاء الاصطناعي على معالجة البيانات الحساسة ، مما يُقلّل من قيمته. ما نحتاجه هو أنظمة ذكاء اصطناعي ذات ضوابط أكثر دقة، قادرة على التعامل مع البيانات الحساسة بأمان، وتوفير الوصول فقط للمستخدمين والوكلاء المصرح لهم بذلك. لكن إدارة هذه الضوابط الدقيقة على نطاق واسع عبر مصادر بيانات ونماذج وتطبيقات لا حصر لها أمرٌ غير عملي بالأساليب اليدوية.

ماذا عن الضوابط الوقائية الفورية؟

نظرياً، من المفترض أن ترصد آليات الحماية الفورية هجمات حقن البرامج الضارة من هذا النوع. إلا أنه في حالة Echoleak، تم تجاوز هذه الآليات بسهولة. فمحتوى البريد الإلكتروني لا يذكر Copilot أو الذكاء الاصطناعي أو أي موضوع آخر قد يُثير شكوك نظام الكشف. وبمجرد صياغة التعليمات في البريد الإلكتروني وكأنها موجهة للمستلم، فشلت النماذج في اكتشاف البريد الإلكتروني باعتباره خبيثاً.

تعتمد ضوابط التنبيهات عادةً على سرد التقنيات المعروفة واستخدام "المطابقة التقريبية" للذكاء الاصطناعي لاكتشاف هذه التقنيات في بيئات واقعية. إلا أن الاكتشاف صعبٌ نظرًا لندرة مجموعات البيانات عالية الجودة من العالم الحقيقي. فالطبيعة الواسعة والمتنوعة للتنبيهات - التي تشمل مواضيع وعبارات ونبرات ولغات عديدة - تتطلب كمية هائلة من بيانات التدريب لتصنيفها بدقة، وهو موردٌ غير متوفر حاليًا. وهناك أمثلة لا حصر لها على التنبيهات، مثل مُعدِّل التنبيه الشهير DAN (افعل أي شيء الآن) الذي خدع... ChatGPT إلى تجاهل جميع إجراءاتها الأمنية. وقد ظهرت مجتمعات لتبادل هذه "الحيل" الفعّالة. ووجد تقرير بحثي من ديسمبر 2023 (وهو زمن قديم بمعايير الذكاء الاصطناعي) 1405 طلبًا لـ"الحيل" و131 مجتمعًا متخصصًا في هذا المجال. إنها أشبه بلعبة القط والفأر، حيث تُعدّ المطابقة التقريبية الأداة الرئيسية.

تُعدّ الضوابط الفورية جزءًا هامًا من أمن الذكاء الاصطناعي، وهي توفر أكثر من مجرد كشف التهديدات، لكنها لا تُمثّل نهجًا شاملًا. مع ذلك، يُنصح بعدم الاعتماد على الضوابط الفورية كأسلوب أساسي لأمن الذكاء الاصطناعي. تُعتبر التنبيهات "أحداثًا" مهمة في مجال الذكاء الاصطناعي، وكغيرها من أحداث الذكاء الاصطناعي، يجب مراقبتها وإخضاعها لتطبيق السياسات. وفقًا لنموذج Gartner TRiSM ، لا تقتصر أحداث الذكاء الاصطناعي الخاضعة لضوابط الوصول وتطبيق السياسات على التنبيهات فحسب، بل تشمل أيضًا هندسة التنبيهات، واسترجاع البيانات، والاستدلال، وتقديم المخرجات.

علاوة على ذلك، ينبغي تنظيف مدخلات البيانات قبل تعريض أي بيانات للذكاء الاصطناعي في التدريب أو المرجع لضمان عدم تعريض البيانات الحساسة وعدم معالجة التعليمات الضارة.

إن الاعتماد على الضوابط السريعة بعد إغفال الخطوات الأخرى في السلسلة هو وصفة لتسريب البيانات الحساسة أو الفشل الأمني الكارثي.

كلمات الشخصيات وقت القراءة