DSPM يجب مراعاة المتطلبات الفريدة لقوانين البيانات والذكاء الاصطناعي

صُممت قوانين ولوائح حماية البيانات لضمان سلامة البيانات، واستخدامها ومعالجتها بشكل عادل، والأهم من ذلك، لحماية حق المستخدمين في الخصوصية. ومع ذلك، ونظرًا لأن الذكاء الاصطناعي أصبح ركيزة أساسية في كل تقنية جديدة تقريبًا، فإن الحاجة إلى المزيد من الإرشادات التنظيمية التي تركز على الذكاء الاصطناعي تتزايد باستمرار. ولهذا، اقترحت حكومات في جميع أنحاء العالم قوانين خاصة بالذكاء الاصطناعي أو سنّتها، مثل قانون الاتحاد الأوروبي للذكاء الاصطناعي، والأمر التنفيذي الأمريكي رقم 14110، وإرشادات لجنة التجارة الفيدرالية الأمريكية بشأن الذكاء الاصطناعي، على سبيل المثال لا الحصر.

لنأخذ على سبيل المثال المادة 10 من قانون الذكاء الاصطناعي للاتحاد الأوروبي - البيانات وحوكمتها. تلزم هذه المادة الجهات المعنية بتدريب مجموعات البيانات والتحقق من صحتها واختبارها وفقًا لأفضل ممارسات حوكمة البيانات وإدارتها. ويجب أن تستخدم مجموعات البيانات ممارسات إعداد البيانات المناسبة، مثل التصنيف والتنظيف والتطهير والتجميع. كما يُطلب من الجهات المعنية اتخاذ تدابير فعالة للكشف عن التحيز ومنعه والتخفيف من آثاره. ويمكن الاطلاع على لوائح مماثلة، وغيرها، تتعلق ببيانات تدريب الذكاء الاصطناعي وحقوق الوصول إلى النماذج، في قوانين أخرى مختلفة خاصة بالذكاء الاصطناعي.

يتطلب التحول إلى الذكاء الاصطناعي والقوانين المرتبطة به DSPM حلول تغطي جميع هذه الجوانب وتوفر ميزة امتثال قوية ومؤتمتة. قد تشمل هذه الميزة إعداد تقارير امتثال تلقائية وتقييمات مخاطر البيانات والذكاء الاصطناعي.

DSPM ينبغي أن يكشف عن التركيبات السامة ويخفف من آثارها

تُعرّف جوجل المجموعات السامة بأنها "مجموعة من المشكلات الأمنية التي، عندما تحدث معًا بنمط معين، تخلق مسارًا إلى واحد أو أكثر من مواردك عالية القيمة والتي يمكن للمهاجم المصمم استخدامها للوصول إلى تلك الموارد واختراقها".

لنأخذ على سبيل المثال بيئة سحابية قد تنطوي على العديد من المخاوف الأمنية، مثل وجود حاوية تخزين غير مهيأة بشكل صحيح، أو تخزين مكشوف للعامة، أو الوصول غير المصرح به إلى بيانات تدريب الذكاء الاصطناعي، وما إلى ذلك. عند النظر إلى كل منها على حدة، قد تبدو هذه المخاطر قابلة للإدارة. ومع ذلك، عند اجتماعها، قد تُحدث تأثيرًا كارثيًا.

ازدادت الحاجة إلى إيجاد حلول للحد من المخاطر الناجمة عن استخدام الذكاء الاصطناعي بشكل كبير مؤخرًا. فقد أضافت هذه التقنية طبقة إضافية من التعقيد إلى البنية التحتية المعقدة أصلًا لتكنولوجيا المعلومات. وقد أدى ذلك إلى تفاقم مشكلات التكوين المتداخلة في المؤسسات، مما خلق مخاطر في بيئات متعددة. ولتوضيح الصورة، أعرب 82% من قادة الأمن عن مخاوفهم من أن الذكاء الاصطناعي سيزيد من حدة هذه المخاطر.

تُنتج الحلول التقليدية، مثل أنظمة إدارة معلومات الأمان والأحداث (SIEM)، عددًا هائلاً من التنبيهات، مما يُصعّب على المحللين فرزها وتحديد أولويات التنبيهات الهامة. علاوة على ذلك، غالبًا ما يتم تجاهل التنبيهات بسبب نقص سياق البيانات. تُساعد التركيبات السامة في تحديد المخاطر الأكثر خطورة وتوجيه جهود المعالجة وفقًا لذلك.

DSPM يجب أن تتبنى الحلول نهجًا قائمًا على الرسوم البيانية في مجال الأمن للكشف عن التداخلات الضارة ومعالجتها. ينبغي أن يوفر الرسم البياني رؤىً حول العلاقة بين البيانات الحساسة والأنظمة والتطبيقات ونماذج الذكاء الاصطناعي، مع تسليط الضوء على التداخلات الضارة حتى لا تمر دون ملاحظة.

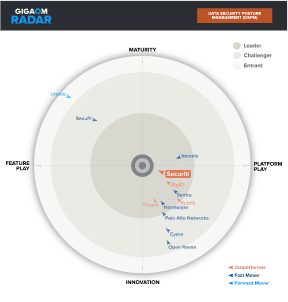

مهتم بمعرفة كيف Securiti 's DSPM هل يمكن أن يساعدك هذا الحل في تطوير استراتيجية أمن بياناتك؟ شاهد ندوتنا عبر الإنترنت عند الطلب ، GigaOm DSPM أبرز النقاط في الرادار: دليلك لأمن البيانات والذكاء الاصطناعي.