انتشار نماذج الذكاء الاصطناعي

لا تقتصر المؤسسات الكبيرة على نموذج ذكاء اصطناعي واحد لتسريع عملياتها ونموها. في الواقع، قد تستخدم المؤسسة الواحدة عددًا من نماذج الذكاء الاصطناعي، إما بنشرها مباشرةً من قِبل المطورين أو بالوصول إليها عبر تطبيق تابع لجهة خارجية (برمجيات كخدمة). يصبح من الصعب على المؤسسات الاحتفاظ بقائمة شاملة لجميع نماذج الذكاء الاصطناعي، ناهيك عن فهرس لأنظمة الذكاء الاصطناعي غير المصرح بها. تُعرف هذه الأنظمة باسم "أنظمة الذكاء الاصطناعي غير المصرح بها"، وهي عبارة عن مجموعة من أنظمة الذكاء الاصطناعي المؤقتة أو غير المصرح بها الموجودة في بيئة العمل، ولكن دون حوكمة تقنية معلومات سليمة. يُعرّض غياب الشفافية بشأن نماذج الذكاء الاصطناعي الموجودة في بيئة العمل AI governance ، وأمن البيانات ، والخصوصية، والامتثال لمعايير تكنولوجيا المعلومات لمخاطر جسيمة.

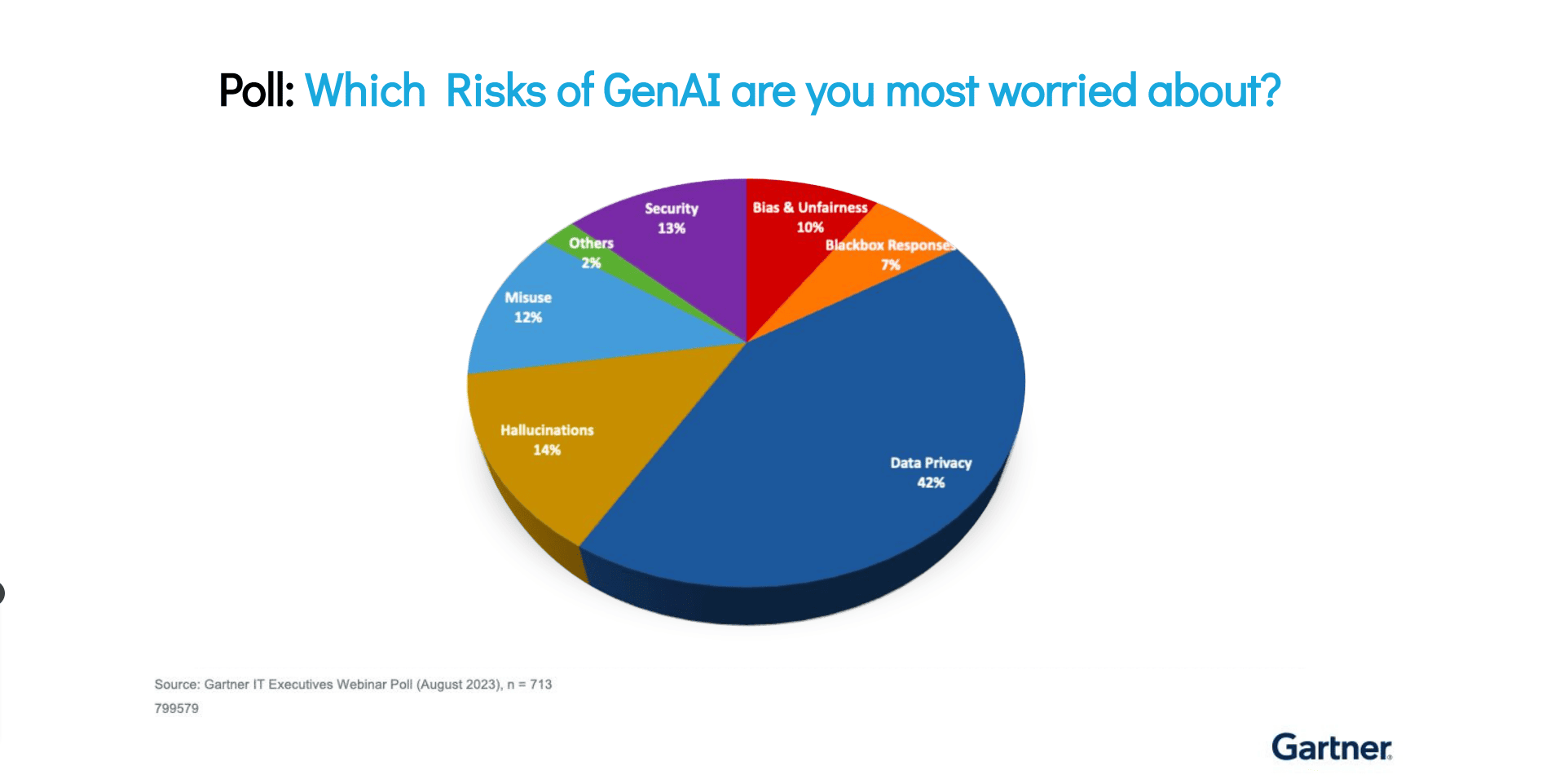

المخاطر الكامنة في نماذج الذكاء الاصطناعي

لا تمتلك المؤسسات حاليًا إطارًا معياريًا لتقييم مخاطر الذكاء الاصطناعي، مما يُصعّب على الفرق الحصول على صورة دقيقة للمخاطر الكامنة في نماذج الذكاء الاصطناعي الخاصة بها. وبسبب غياب طريقة ملموسة لتقييم المخاطر بدقة، غالبًا ما تواجه نماذج الذكاء الاصطناعي مشكلات مثل السمية، والتحيز، والوهم، والتمييز، على سبيل المثال لا الحصر.

ثغرات أمنية في النماذج

تختلف نماذج الذكاء الاصطناعي عن أنظمة البيانات التقليدية. ففي الوقت نفسه، قد يحتوي النموذج الواحد على كمية كبيرة من المعلومات المضغوطة. وقد تتعرض سلامة النموذج أو أمنه للخطر الشديد إذا لم تضمن المؤسسات تطبيق ضوابط أمنية أو ضوابط وصول مناسبة داخل النماذج وحولها. ويمكن أن تؤدي الثغرات الأمنية إلى جعل نماذج الذكاء الاصطناعي عاجزة عن الحماية من التلاعب أو تسريب البيانات أو غيرها من التهديدات الإلكترونية الخبيثة.

بيانات التدريب غير المحمية

إلى جانب نماذج الذكاء الاصطناعي، تزداد أهمية حماية البيانات التي تُغذّي هذه النماذج، أي بيانات التدريب. تتطلب نماذج الذكاء الاصطناعي بيانات تدريب لتعمل بكفاءة وتقدم نتائج دقيقة. من الضروري أن يكون لدى فرق العمل فهم واضح للبيانات التي يجب السماح بالوصول إليها لتدريب نموذج الذكاء الاصطناعي، وأنواع البيانات التي يجب تقييدها، كالبيانات الحساسة . عندما تفتقر فرق العمل إلى معرفة البيانات المستخدمة في تدريب النموذج، قد تنشأ مخاوف بشأن صلاحيات الوصول. وغني عن القول، إن عدم كفاية صلاحيات الوصول يؤدي إلى احتمالية تسريب البيانات الحساسة والوصول غير المصرح به إلى بيانات التدريب.

وكلاء الذكاء الاصطناعي غير المحميين والمطالبات

لا ينبغي أن تقتصر ضوابط الأمن والحوكمة والخصوصية على نماذج الذكاء الاصطناعي أو بيانات التدريب فقط، بل يجب توسيع نطاقها ليشمل التنبيهات والوكلاء. من الأهمية بمكان أن تضع المؤسسات ضوابط صارمة حول تنبيهات الذكاء الاصطناعي ووكلاءه، لأن إهمال هذه الجوانب الحيوية قد يفتح المجال لتفاعلات ضارة مع النماذج، مما يعرض سلامة المستخدمين والمبادئ الأخلاقية للخطر.

متاهة تنظيمية دائمة التغير

هناك العديد من اللوائح التنظيمية المتعلقة بالذكاء الاصطناعي قيد الإعداد. فقد أصدرت أمريكا الشمالية مؤخرًا إطار AI governance ، أو مجموعة من المبادئ التوجيهية، في شكل أمر تنفيذي خاص بالذكاء الاصطناعي . وبالمثل، يُعد قانون الذكاء الاصطناعي للاتحاد الأوروبي قانونًا شاملًا آخر في هذا المجال، وقد أثار جدلًا واسعًا عند إصداره. كما ستصدر لوائح ومعايير جديدة، وستخضع لتعديلات مع تطور التكنولوجيا. وللامتثال لهذه اللوائح والمعايير المتعلقة بالذكاء الاصطناعي، من الضروري أن تتمتع المؤسسات برؤية شاملة لنماذج الذكاء الاصطناعي، وبيانات التدريب، والتنبيهات، وصلاحيات الوصول، وسياسات المعالجة. فبدون هذه المعلومات الأساسية، يصعب وضع ضوابط مناسبة، فضلًا عن ضمان الامتثال.

ما هو نهج الذكاء الاصطناعي TRiSM؟

يرمز اختصار AI TRiSM إلى إدارة الثقة والمخاطر والأمن. وهو إطار عمل شامل يمكّن المؤسسات من ضمان "حوكمة نماذج الذكاء الاصطناعي، وجدارتها بالثقة، وعدالتها، وموثوقيتها، وقوتها، وفعاليتها، وحماية بياناتها"، وفقًا لتعريف غارتنر . في الواقع، تشير غارتنر إلى أن المؤسسات التي تُفعّل ذكاءً اصطناعيًا آمنًا وجديرًا بالثقة ستحقق زيادة بنسبة 50% في تبنيها للذكاء الاصطناعي وتحقيق أهدافها التجارية.